تم تصميم وحدات معالجة الرسومات (GPU) لتقديم الرسومات في الوقت الفعلي. ومع ذلك ، فقد اتضح أن ما يجعل وحدات معالجة الرسومات رائعة في الرسومات يجعلها رائعة أيضًا في وظائف معينة بخلاف الرسومات. يُعرف هذا باسم حوسبة GPU.

كيف تختلف وحدات المعالجة المركزية ووحدات معالجة الرسومات؟

من حيث المبدأ ، تعد كل من وحدات معالجة الرسومات ووحدات المعالجة المركزية (وحدات المعالجة المركزية) منتجات من نفس التكنولوجيا. يوجد داخل كل جهاز معالجات تتكون من ملايين إلى مليارات المكونات الإلكترونية الدقيقة ، خاصة الترانزستورات. تشكل هذه المكونات عناصر المعالج مثل البوابات المنطقية ومن هناك يتم دمجها في هياكل معقدة تحول الشفرة الثنائية إلى تجارب الكمبيوتر المعقدة التي نمتلكها اليوم.

الاختلاف الرئيسي بين وحدات المعالجة المركزية ووحدات معالجة الرسومات هو التوازي . في وحدة المعالجة المركزية الحديثة ، ستجد عدة أنوية معقدة وعالية الأداء لوحدة المعالجة المركزية. أربعة نوى نموذجية لأجهزة الكمبيوتر السائدة ، لكن وحدات المعالجة المركزية سداسية وثمانية النواة أصبحت سائدة. قد تحتوي أجهزة الكمبيوتر الاحترافية المتطورة على عشرات أو حتى أكثر من 100 نواة لوحدة المعالجة المركزية ، خاصة مع اللوحات الأم متعددة المقابس التي يمكنها استيعاب أكثر من وحدة معالجة مركزية واحدة.

يمكن لكل نواة من وحدات المعالجة المركزية أن تفعل شيئًا واحدًا أو (مع فرط مؤشرات الترابط ) شيئين في وقت واحد. ومع ذلك ، يمكن أن تكون هذه الوظيفة أي شيء تقريبًا ويمكن أن تكون معقدة للغاية. تتمتع وحدات المعالجة المركزية (CPU) بمجموعة متنوعة من قدرات المعالجة والتصميمات الذكية بشكل لا يصدق والتي تجعلها فعالة في حل العمليات الحسابية المعقدة.

عادةً ما تحتوي وحدات معالجة الرسومات الحديثة على آلاف المعالجات البسيطة. على سبيل المثال ، تحتوي وحدة معالجة الرسومات RTX 3090 من Nvidia على 10496 نواة GPU هائلة. على عكس وحدة المعالجة المركزية ، فإن كل نواة GPU بسيطة نسبيًا بالمقارنة ومصممة للقيام بأنواع الحسابات المعتادة في عمل الرسومات. ليس هذا فقط ، ولكن كل هذه الآلاف من المعالجات يمكنها العمل على جزء صغير من مشكلة عرض الرسومات في نفس الوقت. هذا ما نعنيه ب “التوازي”.

حوسبة الأغراض العامة على GPUS (GPGPU)

تذكر أن وحدات المعالجة المركزية (CPU) ليست متخصصة ويمكنها إجراء أي نوع من العمليات الحسابية ، بغض النظر عن الوقت الذي يستغرقه إنهاء العمل. في الواقع ، يمكن لوحدة المعالجة المركزية أن تفعل أي شيء يمكن لوحدة معالجة الرسومات القيام به ، ولا يمكنها القيام بذلك بسرعة كافية لتكون مفيدة في تطبيقات الرسومات في الوقت الفعلي.

إذا كان هذا هو الحال ، فعندئذ يكون العكس صحيحًا أيضًا إلى حد ما. يمكن لوحدات معالجة الرسومات إجراء بعض العمليات الحسابية نفسها التي نطلبها عادةً من وحدات المعالجة المركزية (CPU) ، ولكن نظرًا لامتلاكها تصميم معالجة متوازية شبيه بالحاسوب الفائق ، يمكنها القيام بذلك بسرعة أكبر. هذا هو GPGPU: استخدام وحدات معالجة الرسومات للقيام بأحمال عمل وحدة المعالجة المركزية التقليدية.

يستخدم صانعو GPU الرئيسيون (NVIDIA و AMD) لغات وهندسة برمجة خاصة للسماح للمستخدمين بالوصول إلى ميزات GPGPU. في حالة Nvidia ، هذا هو CUDA أو Compute Unified Device Architecture. هذا هو السبب في أنك سترى معالجات GPU الخاصة بهم يشار إليها باسم نوى CUDA.

نظرًا لأن CUDA هي ملكية خاصة ، فلا يمكن لصانعي GPU المتنافسين مثل AMD استخدامها. بدلاً من ذلك ، تستخدم وحدات معالجة الرسومات الخاصة بـ AMD OpenCL أو Open Computing Language) . هذه لغة GPGPU تم إنشاؤها بواسطة مجموعة من الشركات التي تشمل Nvidia و Intel.

وحدات معالجة الرسومات في البحث العلمي

أحدثت حوسبة GPU ثورة في ما يمكن للعلماء فعله بميزانيات أصغر بكثير من ذي قبل. التنقيب في البيانات ، حيث تبحث أجهزة الكمبيوتر عن أنماط مثيرة للاهتمام في جبال البيانات ، مما يكتسب رؤى يمكن أن تضيع في الضوضاء.

تستخدم مشاريع مثل Folding @ Home وقت معالجة GPU المنزلي الذي تبرع به المستخدمون للعمل على مشاكل خطيرة مثل السرطان. تعد وحدات معالجة الرسومات مفيدة لجميع أنواع المحاكاة العلمية والهندسية التي كان من الممكن أن تستغرق سنوات لإكمالها في الماضي وملايين الدولارات في الوقت المناسب مستأجرة على أجهزة الكمبيوتر العملاقة الكبيرة.

وحدات معالجة الرسومات في الذكاء الاصطناعي

تعد وحدات معالجة الرسومات رائعة أيضًا في أنواع معينة من وظائف الذكاء الاصطناعي. يعد التعلم الآلي (ML) أسرع بكثير على وحدات معالجة الرسومات من وحدات المعالجة المركزية (CPU) وأحدث طرز GPU بها أجهزة تعلم آلي أكثر تخصصًا مضمنة فيها.

أحد الأمثلة العملية على كيفية استخدام وحدات معالجة الرسومات لتطوير تطبيقات الذكاء الاصطناعي في العالم الحقيقي هو ظهور السيارات ذاتية القيادة . وفقًا لـ Tesla ، تطلب برنامج Autopilot الخاص بهم 70000 ساعة من GPU لـ “تدريب” الشبكة العصبية بالمهارات اللازمة لقيادة السيارة. سيكون القيام بنفس المهمة على وحدات المعالجة المركزية (CPU) مكلفًا للغاية ويستغرق وقتًا طويلاً.

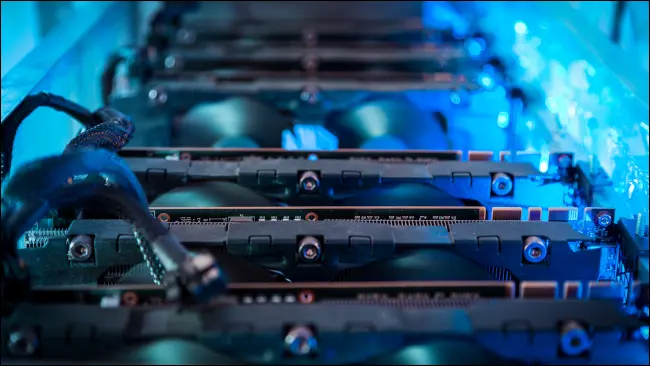

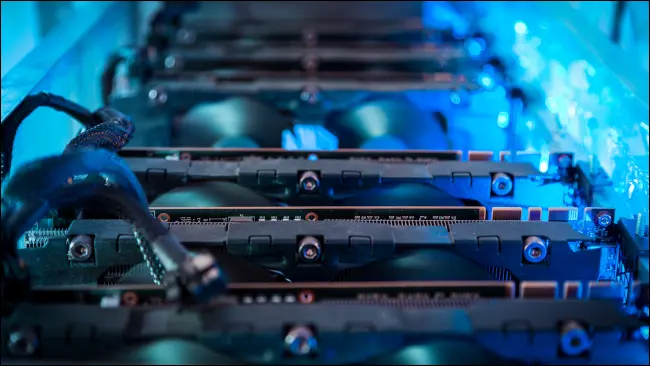

وحدات معالجة الرسومات في تعدين العملات المشفرة

تعد وحدات معالجة الرسوميات ممتازة أيضًا في حل ألغاز التشفير ، ولهذا أصبحت شائعة في تعدين العملات المشفرة . على الرغم من أن وحدات معالجة الرسوم (GPU) لا تقوم بتعدين العملات المشفرة بأسرع ما في ASICs (الدوائر المتكاملة الخاصة بالتطبيق) ، إلا أنها تتمتع بميزة مميزة تتمثل في كونها متعددة الاستخدامات. عادةً ما يمكن لـ ASIC تعدين نوع واحد محدد أو مجموعة صغيرة من العملات المشفرة ولا شيء آخر.

تعد وحدات معالجة الرسوميات ممتازة أيضًا في حل ألغاز التشفير ، ولهذا أصبحت شائعة في تعدين العملات المشفرة . على الرغم من أن وحدات معالجة الرسوم (GPU) لا تقوم بتعدين العملات المشفرة بأسرع ما في ASICs (الدوائر المتكاملة الخاصة بالتطبيق) ، إلا أنها تتمتع بميزة مميزة تتمثل في كونها متعددة الاستخدامات. عادةً ما يمكن لـ ASIC تعدين نوع واحد محدد أو مجموعة صغيرة من العملات المشفرة ولا شيء آخر.

يُعد معدِّن العملات المشفرة أحد الأسباب الرئيسية التي تجعل وحدات معالجة الرسومات باهظة الثمن ويصعب العثور عليها ، على الأقل في وقت كتابة هذا التقرير في أوائل عام 2022. إن تجربة ارتفاعات تقنية GPU تعني الدفع غاليًا ، مع السعر الجاري لـ NVIDIA GeForce RTX 3090 أكثر من 2500 دولار. لقد أصبحت مشكلة أن NVIDIA قد حدت بشكل مصطنع من أداء التشفير لوحدات معالجة الرسومات للألعاب وقدمت منتجات GPU الخاصة بالتعدين .

يمكنك استخدام GPGPU أيضًا!

على الرغم من أنك قد لا تكون على دراية بذلك دائمًا ، إلا أن بعض البرامج التي تستخدمها كل يوم تقوم بإلغاء تحميل بعض معالجتها إلى وحدة معالجة الرسومات الخاصة بك. إذا كنت تعمل باستخدام برنامج تحرير الفيديو أو أدوات معالجة الصوت ، على سبيل المثال ، فهناك فرصة جيدة لتحمل وحدة معالجة الرسومات الخاصة بك بعض الحمل. إذا كنت ترغب في معالجة مشاريع مثل صنع التزييف العميق الخاص بك في المنزل ، فإن وحدة معالجة الرسومات الخاصة بك هي مرة أخرى المكون الذي يجعل ذلك ممكنًا.

تعد وحدة معالجة الرسومات الخاصة بهاتفك الذكي مسؤولة أيضًا عن تشغيل العديد من وظائف الذكاء الاصطناعي ورؤية الآلة التي كان من الممكن إرسالها إلى أجهزة الكمبيوتر السحابية للقيام بها. لذلك يجب أن نكون جميعًا ممتنين لأن وحدات معالجة الرسومات يمكنها فعل أكثر من مجرد رسم صورة جذابة على شاشتك.

تعد وحدات معالجة الرسوميات ممتازة أيضًا في حل ألغاز التشفير ، ولهذا أصبحت شائعة في

تعد وحدات معالجة الرسوميات ممتازة أيضًا في حل ألغاز التشفير ، ولهذا أصبحت شائعة في